|

Портал |

|

|

ü

ü

ü

ü

ü

ü

ü

ü

ü

ü

ü

ü

ü

ü

ü

|

Интересное |

|

|

ü

ü

ü

ü

ü

ü

ü

ü

ü

|

|

Ювелирные новости Кыргызстана<< Назад к списку новотей Наука скоро станет намного более захватывающей, и это повлияет на всех нас, - Эрик Шмидт, экс-глава Google Наука скоро станет намного более захватывающей, и это повлияет на всех нас, утверждает бывший генеральный директор Google. Наука скоро станет намного более захватывающей, и это повлияет на всех нас, утверждает бывший генеральный директор Google.

Эрик Шмидт

MIT Technology Review

Это еще одно лето экстремальной погоды с беспрецедентной жарой, лесными пожарами и наводнениями в странах по всему миру. В ответ на задачу точного прогнозирования таких крайностей полупроводниковый гигант Nvidia создает "цифрового близнеца" на базе искусственного интеллекта для всей планеты.

Этот цифровой двойник, названный Earth-2, будет использовать прогнозы FourCastNet, модели искусственного интеллекта, которая использует десятки терабайт данных системы Земли и может предсказывать погоду на следующие две недели в десятки тысяч раз быстрее и точнее, чем существующие методы прогнозирования.

Обычные системы прогнозирования погоды способны генерировать около 50 прогнозов на неделю вперед. Вместо этого FourCastNet может предсказывать тысячи возможностей, точно фиксируя риск редких, но смертоносных бедствий и тем самым предоставляя уязвимым группам населения драгоценное время для подготовки и эвакуации.

Долгожданная революция в моделировании климата - это только начало. С появлением ИИ наука станет намного более захватывающей и в некотором смысле неузнаваемой. Отголоски этого сдвига будут ощущаться далеко за пределами лаборатории; они коснутся всех нас.

Если мы правильно разыграем наши карты, обеспечив разумное регулирование и надлежащую поддержку инновационного использования ИИ для решения самых насущных научных проблем, ИИ сможет переписать научный процесс. Мы можем построить будущее, в котором инструменты на основе ИИ избавят нас от бессмысленного и трудоемкого труда, а также приведут нас к творческим изобретениям и открытиям, способствуя прорывам, на которые в противном случае ушли бы десятилетия.

ИИ в последние месяцы стал почти синонимом больших языковых моделей или LLM, но в науке существует множество различных архитектур моделей, которые могут иметь еще большее влияние. За последнее десятилетие наибольший прогресс в науке был достигнут за счет более мелких "классических" моделей, ориентированных на конкретные вопросы. Эти модели уже привели к значительным достижениям. Совсем недавно более крупные модели глубокого обучения, которые начинают включать междоменные знания и генеративный ИИ, расширили возможности.

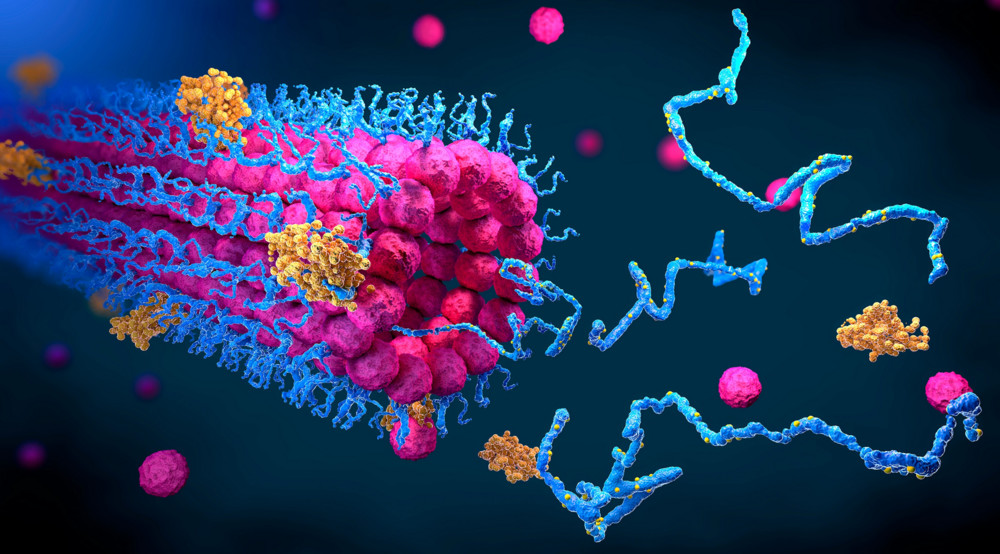

Например, ученые из Макмастера и Массачусетского технологического института использовали модель искусственного интеллекта для определения антибиотика для борьбы с патогеном, который Всемирная организация здравоохранения назвала одной из самых опасных в мире устойчивых к антибиотикам бактерий для пациентов больниц. Модель Google DeepMind может управлять плазмой в реакциях ядерного синтеза, приближая нас к революции чистой энергии. В сфере здравоохранения Управление по санитарному надзору за качеством пищевых продуктов и медикаментов США уже одобрило 523 устройства, использующих ИИ, - 75% из них для использования в радиологии.

Переосмысление науки

По своей сути научный процесс, которому мы все научились в начальной школе, останется прежним: провести предварительное исследование, определить гипотезу, проверить ее экспериментально, проанализировать собранные данные и прийти к выводу. Но ИИ может революционизировать внешний вид каждого из этих компонентов в будущем.

Искусственный интеллект уже меняет то, как некоторые ученые проводят обзоры литературы. Такие инструменты, как PaperQA и Elicit, используют LLM для сканирования баз данных статей и создания кратких и точных обзоров существующей литературы, включая цитаты.

После завершения обзора литературы ученые формируют гипотезу для проверки. LLM по своей сути работают, предсказывая следующее слово в предложении, создавая целые предложения и абзацы. Этот метод делает LLM уникальными подходящими для масштабных задач, присущих иерархической структуре науки, и может позволить им предсказать следующее большое открытие в физике или биологии.

ИИ также может расширять сеть поиска гипотез и быстрее ее сужать. В результате инструменты ИИ могут помочь сформулировать более сильные гипотезы, например, модели, которые выявляют более многообещающие кандидаты для новых лекарств. Мы уже видим, как моделирование работает на несколько порядков быстрее, чем всего несколько лет назад, что позволяет ученым опробовать больше вариантов дизайна в моделировании, прежде чем проводить эксперименты в реальном мире.

Например, ученые из Калифорнийского технологического института использовали имитационную модель жидкости с искусственным интеллектом, чтобы автоматически разработать более совершенный катетер, который не позволяет бактериям плыть вверх по течению и вызывать инфекции. Такого рода способность коренным образом изменит постепенный процесс научных открытий, позволив исследователям разрабатывать оптимальное решение с самого начала, а не продвигаться по длинной череде все более совершенных проектов, как мы видели в годы инноваций в области нитей накаливания в конструкции лампочек.

Переходя к этапу экспериментов, ИИ сможет проводить эксперименты быстрее, дешевле и в большем масштабе. Например, мы можем создавать машины на базе искусственного интеллекта с сотнями микропипеток, работающих день и ночь, чтобы создавать образцы со скоростью, с которой не может сравниться ни один человек. Вместо того чтобы ограничиваться шестью экспериментами, ученые могут использовать инструменты искусственного интеллекта для проведения тысяч.

Ученые, которые беспокоятся о своем следующем гранте, публикации или процессе пребывания в должности, больше не будут привязаны к безопасным экспериментам с наивысшими шансами на успех; они смогут свободно выдвигать более смелые и междисциплинарные гипотезы. Например, при оценке новых молекул исследователи склонны выбирать кандидатов, схожих по структуре с теми, которые мы уже знаем, но модели ИИ не обязательно должны иметь такие же предубеждения и ограничения.

В конце концов, большая часть научных исследований будет проводиться в "автономных лабораториях" - автоматизированных роботизированных платформах в сочетании с искусственным интеллектом. Здесь мы можем перенести мастерство ИИ из цифровой сферы в физический мир. Такие беспилотные лаборатории уже появляются в таких компаниях, как Emerald Cloud Lab и Artificial, и даже в Аргоннской национальной лаборатории.

Наконец, на этапе анализа и заключения лаборатории беспилотных автомобилей выйдут за рамки автоматизации и, опираясь на полученные экспериментальные результаты, будут использовать LLM для интерпретации результатов и рекомендации для проведения следующего эксперимента. Затем, как партнеры в исследовательском процессе, ассистент лаборатории ИИ может заказать расходные материалы для замены тех, которые использовались в предыдущих экспериментах, а также настроить и провести следующие рекомендуемые эксперименты на ночь, чтобы результаты были готовы к утру, пока экспериментатор спит дома..

Возможности и ограничения

Молодые исследователи могут нервно ерзать на своих местах от перспективы. К счастью, новые рабочие места, которые появятся в результате этой революции, скорее всего, будут более творческими и менее бессмысленными, чем большинство современных лабораторных работ.

Инструменты искусственного интеллекта могут снизить входной барьер для новых ученых и открыть возможности для тех, кто традиционно был исключен из этой области. С LLM, способными помочь в создании кода, студентам STEM больше не придется осваивать малоизвестные языки кодирования, открывая двери башни из слоновой кости для новых, нетрадиционных талантов и облегчая ученым работу в областях, выходящих за рамки их собственных. Вскоре специально обученные LLM могут выйти за рамки предложения первых черновиков письменных работ, таких как предложения о грантах, и могут быть разработаны, чтобы предлагать "равноправные" рецензии новых статей вместе с рецензентами.

Инструменты искусственного интеллекта обладают невероятным потенциалом, но мы должны понимать, где человеческое прикосновение все еще важно, и избегать бега, прежде чем мы сможем ходить. Например, успешное объединение ИИ и робототехники в беспилотных лабораториях будет непростым делом. В лабораториях ученые изучают множество неявных знаний, которые трудно передать робототехнике с искусственным интеллектом. Точно так же мы должны осознавать ограничения - и даже галлюцинации - современных LLM, прежде чем перекладывать на них большую часть нашей бумажной работы, исследований и анализа.

Такие компании, как OpenAI и DeepMind, по-прежнему лидируют в новых прорывах, моделях и исследовательских работах, но нынешнее доминирование в отрасли не будет длиться вечно. До сих пор DeepMind преуспевал, сосредоточившись на четко определенных проблемах с четкими целями и показателями. Один из его самых известных успехов был достигнут на "Критической оценке прогнозирования структуры", проводимом раз в два года конкурсе, в ходе которого исследовательские группы предсказывают точную форму белка по порядку расположения в нем аминокислот.

С 2006 по 2016 год средний балл в самой сложной категории варьировался от 30 до 40 по шкале CASP от 1 до 100. Неожиданно в 2018 году модель DeepMind AlphaFold набрала колоссальные 58 баллов. Обновленная версия под названием AlphaFold2 два года спустя набрала 87 баллов. оставляя своих конкурентов-людей еще дальше в пыли.

Благодаря ресурсам с открытым исходным кодом мы начинаем видеть закономерность, когда промышленность достигает определенных эталонных показателей, а затем научные круги вмешиваются для уточнения модели. После того, как DeepMind выпустила AlphaFold, Минкьюнг Бэк и Дэвид Бейкер из Вашингтонского университета выпустили RoseTTAFold, который использует структуру DeepMind для прогнозирования структур белковых комплексов, а не только отдельных белковых структур, с которыми изначально могла работать AlphaFold. Что еще более важно, ученые более защищены от конкурентного давления рынка, поэтому они могут выйти за рамки четко определенных проблем и измеримых успехов, которые привлекают DeepMind.

Помимо достижения новых высот, ИИ может помочь проверить то, что мы уже знаем, решая проблему научного кризиса воспроизводимости. Около 70% ученых сообщают, что им не удалось воспроизвести эксперимент другого ученого - цифра обескураживающая. Поскольку ИИ снижает затраты и усилия на проведение экспериментов, в некоторых случаях будет легче воспроизвести результаты или сделать вывод о том, что они не могут быть воспроизведены, что способствует большему доверию к науке.

Ключом к воспроизводимости и доверию является прозрачность. В идеальном мире все в науке было бы в открытом доступе, от статей без платного доступа до данных, кода и моделей с открытым исходным кодом. К сожалению, из-за опасностей, которые могут таить в себе такие модели, не всегда реально сделать все модели открытыми. Во многих случаях риски полной прозрачности перевешивают преимущества доверия и справедливости. Тем не менее, насколько мы можем быть прозрачными с моделями - особенно с классическими моделями ИИ с более ограниченным использованием - мы должны быть прозрачными.

Важность регулирования

Во всех этих областях важно помнить об ограничениях и рисках, присущих искусственному интеллекту. ИИ - такой мощный инструмент, потому что он позволяет людям делать больше с меньшими затратами: меньше времени, меньше образования, меньше оборудования. Но эти возможности делают его опасным оружием в чужих руках. Эндрю Уайт, профессор Университета Рочестера, был нанят OpenAI для участия в " красной команде ", которая могла выявить риски GPT-4 до его выпуска. Используя языковую модель и предоставив ей доступ к инструментам, Уайт обнаружил, что может предлагать опасные соединения и даже заказывать их у поставщика химикатов. Чтобы проверить процесс, на следующей неделе ему домой отправили (безопасное) тестовое соединение. OpenAI говорит, что использовала его выводы для настройки GPT-4 перед его выпуском.

Даже люди с абсолютно добрыми намерениями могут подтолкнуть ИИ к плохим результатам. Нам следует меньше беспокоиться о создании Терминатора и, как выразился ученый-компьютерщик Стюарт Рассел, больше о том, чтобы стать королем Мидасом, который хотел, чтобы все, к чему он прикасался, превращался в золото, и тем самым случайно убил свою дочь объятиями.

У нас нет механизма, который побудил бы ИИ изменить свою цель, даже если он реагирует на свою цель не так, как мы ожидаем. В одной часто цитируемой гипотезе вас просят представить, что вы говорите ИИ, чтобы он произвел как можно больше скрепок. Будучи преисполнена решимости достичь своей цели, модель захватывает электрическую сеть и убивает любого человека, который пытается остановить это, поскольку скрепки продолжают накапливаться. Мир остается в руинах. ИИ хлопает себя по спине; он сделал свою работу. (Ссылаясь на этот знаменитый мысленный эксперимент, многие сотрудники OpenAI носят с собой фирменные скрепки.)

OpenAI удалось внедрить впечатляющий набор мер безопасности, но они будут действовать только до тех пор, пока GPT-4 размещается на серверах OpenAI. Вероятно, скоро наступит день, когда кому-то удастся скопировать модель и разместить ее на своих серверах. Такие пограничные модели должны быть защищены, чтобы воры не смогли снять ограждения безопасности ИИ, которые так тщательно были добавлены их первоначальными разработчиками.

Источник: akipress.kg

|

|